Künstliche Intelligenz: Large Language Models (LLM)

Meine Kunden in der KI-Beratung fragen mich oft: „Was sind Large Language Models (LLMs)?“ In der KI-Welt tobt ein Wettlauf um die Vorherrschaft in der natürlichen Sprachverarbeitung. Large Language Models (LLMs) sind die Protagonisten dieses Wettlaufs und verschieben mit ihrer Fähigkeit, menschenähnlichen Text zu generieren und zu verstehen, ständig die Grenzen des Möglichen. Doch welches Modell hat die Nase vorn? Tauchen wir ein in die faszinierende Welt der LLMs.

Künstliche Intelligenz: Was ist ein großes Sprachmodell?

Large Language Models (LLMs) sind hochentwickelte KI-Systeme, die menschliche Sprache in Textform verarbeiten, verstehen und generieren. Basierend auf Deep-Learning-Techniken und riesigen Datensätzen mit Milliarden von Wörtern aus verschiedenen Quellen erfassen diese Modelle die Feinheiten von Sprache, Grammatik, Kontext und Allgemeinwissen.

Ob es um die Beantwortung von Fragen, die Zusammenfassung von Texten, die Übersetzung von Sprachen oder auch die Führung interaktiver Gespräche geht – LLMs meistern ein breites Aufgabenspektrum mit bemerkenswerter Kompetenz.

Was ist der Unterschied zwischen proprietärem und Open Source LLM?

Es gibt einen klaren Unterschied zwischen proprietären und Open-Source-LLM-Modellen. Proprietäre Modelle wie GPT-3 von OpenAI oder PaLM von Google werden von Technologieunternehmen entwickelt und sind in der Regel nur über kostenpflichtige APIs zugänglich.

Im Gegensatz dazu sind Open-Source-Modelle wie BLOOM von Hugging Face oder LLaMA von Meta frei verfügbar und können von der Community weiterentwickelt werden. Während proprietäre Modelle oft eine höhere Leistung und bessere Ressourcen bieten, ermöglichen Open-Source-LLMs mehr Transparenz, Anpassungsfähigkeit und kollaborative Entwicklung.

Welche Bestandteile hat ein LLM?

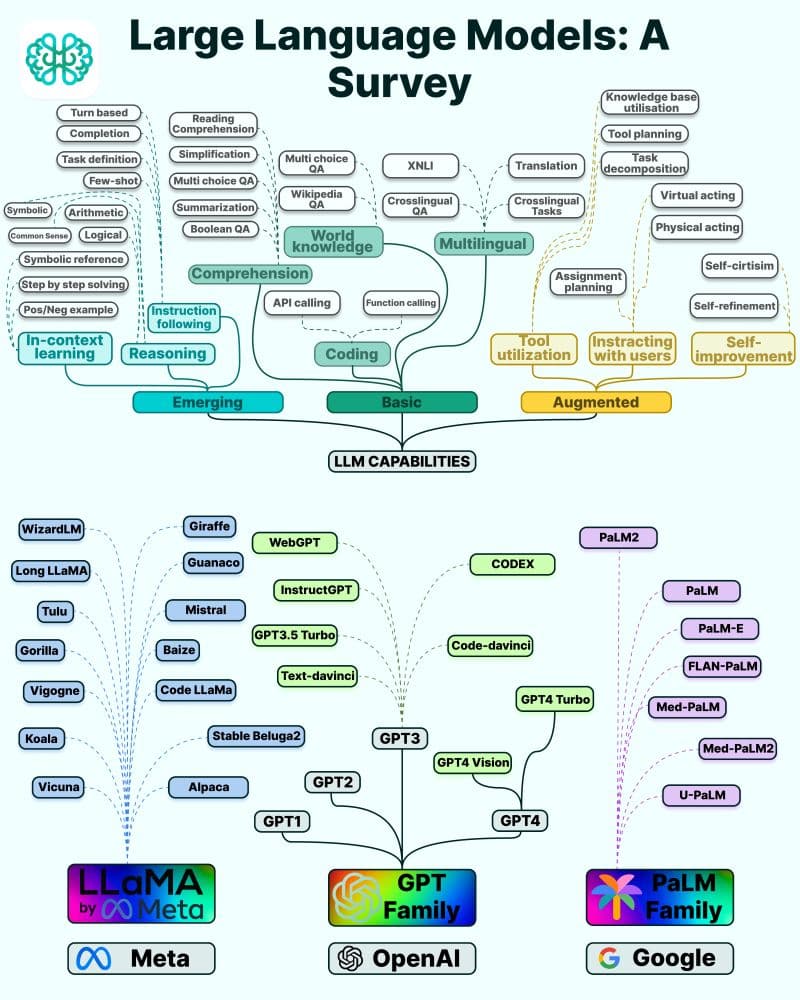

In dieser Grafik siehst du die Komponenten von LLMs wie „Emerging, Basic und Augmented“ sowie die LLM-Typen wie Meta, OpenAI und Google. Die Fachbegriffe werden unten erklärt. Bildquelle: https://genai.works/

Was sind die LLM-Komponenten im Einzelnen?

- Retrieval Augmented Generation (RAG) : Eine Methode, die ein Information-Retrieval-Modul mit einem Textgenerierungsmodell kombiniert. Dies ermöglicht LLMs, auf externe Wissensquellen zuzugreifen und ihre Antworten mit aktuellen und relevanten Informationen anzureichern.

- Reinforcement Learning from Human Feedback (RLHF) : Eine Technik, bei der LLMs mithilfe von Datensätzen mit menschlichen Präferenzen weiter feinabgestimmt werden, um ihre Ergebnisse zu verbessern.

- Anweisungsoptimierung : LLMs lernen, auf der Grundlage menschlicher Korrekturen einiger Beispiele richtige Antworten zu generieren.

- Mixture of Experts (MoE) : Eine Technik, bei der sehr große LLMs in kleinere, spezialisierte Modelle aufgeteilt werden, um Ressourcen effizienter zu nutzen.

Welche wichtigen großen Sprachmodelle gibt es?

Meta-LLMs wie LLaMA und LLaMA 2: Von Meta AI entwickelte Open-Source-LLMs, die zur Feinabstimmung und kommerziellen Nutzung verfügbar sind.

OpenAI LLMs wie GPT-4 und ChatGPT: Leistungsstarke proprietäre LLMs von OpenAI, zugänglich über APIs (einige gegen Gebühr).

Google LLMs wie LaMDA und PaLM: Eigene LLM-Entwicklungen von Google, die in einigen Google-Produkten zum Einsatz kommen. Darüber hinaus gibt es zahlreiche Open-Source-LLMs von Universitäten und Forschungseinrichtungen wie Alpaca, Vicuna und Dolly 2, die als kostengünstige Alternativen dienen.

Darüber hinaus gibt es noch zahlreiche weitere kleinere LLMs.

Welcher LLM ist der beste?

Die Antwort hängt von den spezifischen Anforderungen und Anwendungsfällen ab. Hier findest du eine tabellarische Übersicht über einige der führenden LLMs und ihre Stärken. Mit Perplexity AI kannst du beispielsweise das Tool so konfigurieren, dass es das für dich optimale LLM auswählt. Meiner langjährigen Erfahrung nach führt dies in der Praxis zu den besten Ergebnissen. Hier findest du eine Tabelle mit weiteren Informationen zu den führenden großen Sprachmodellen inklusive Details.

| Modell | Entwickler | Typ | Größe | Kontextfenster | Mehrsprachigkeit | Besondere Stärken |

|---|---|---|---|---|---|---|

| GPT-4 | OpenAI | Proprietär | 175 Milliarden Parameter | 32.768 Token | Gut | Allgemeine Leistung, multimodal (Text und Bilder), strukturierte Antworten |

| Palme | Proprietär | 540 Milliarden Parameter | 64.000 Token | Sehr gut | Mehrsprachige Bearbeitung, Zusammenfassungen, Analysen | |

| Claude | Anthropisch | Proprietär | Unbekannt | 1 Million Token | Gut | Riesiges Kontextfenster, Analysen, Codegenerierung, spezialisierte Modellvarianten |

| BLÜHEN | Umarmendes Gesicht | Open Source | 176 Milliarden Parameter | 4.096 Token | Durchschnitt | Vielseitigkeit, Community-Entwicklung, Anpassungsfähigkeit |

| Anrufe | Meta | Open Source | 65 Milliarden Parameter | 4.096 Token | Gut | Effizienz, Anpassungsfähigkeit, geringes Gewicht |

| OPT | Meta | Open Source | 175 Milliarden Parameter | 2.048 Token | Durchschnitt | Offene Vortrainingsmodelle, Anpassungsfähigkeit |

Erklärungen zu den Spalten für KI-Einsteiger

- Größe : Die Anzahl der Parameter, mit denen das Modell trainiert wurde. Mehr Parameter bedeuten im Allgemeinen eine höhere Leistung, aber auch einen höheren Ressourcenverbrauch.

- Kontextfenster : Die maximale Anzahl von Token (Wörtern), die das Modell gleichzeitig verarbeiten kann. Ein größeres Kontextfenster ermöglicht längere und komplexere Eingaben.

- Mehrsprachigkeit : Bewertet, wie gut das Modell mit mehreren Sprachen umgehen kann.

- Besondere Stärken : Hebt die wesentlichen Stärken und Anwendungsbereiche des jeweiligen Modells hervor.

Die Tabelle zeigt, dass sowohl proprietäre als auch Open-Source-Modelle ihre spezifischen Stärken und Schwächen haben. Während proprietäre Modelle oft leistungsfähiger sind, bieten Open-Source-Lösungen mehr Flexibilität und Anpassbarkeit. Erfahren Sie, wie künstliche Intelligenz funktioniert.

Zertifikatskurse für KI-Experten mit 90%-Förderung für Freelancer

Bring dein Business mit KI auf das nächste Level! Bilde dich zum KI-Manager oder KI-Berater weiter . Erfahre mehr im Webinar: KI-Kurse mit 90 Prozent staatlicher Förderung für Freelancer .